Roboti se stali rasisty a sexisty. Umělá inteligence není nakonec tak chytrá

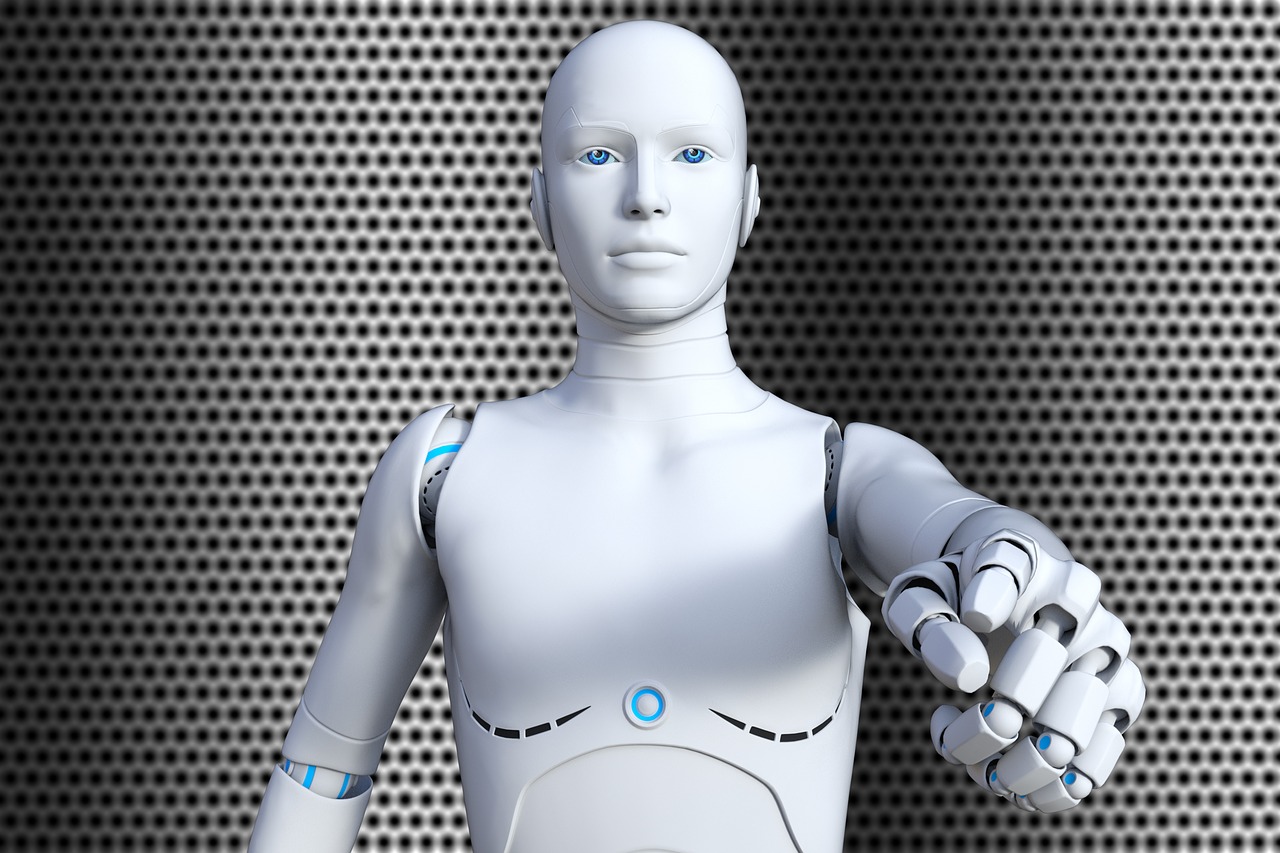

Vývoj robotiky a algoritmů umělé inteligence je neuvěřitelný. Právě do těchto oblastí investují různé společnosti miliardy dolarů. Došlo to dokonce tak daleko, že se někteří začali chovat jako lidé – v negativním slova smyslu. Projevují se sexisticky a rasisticky, píše server Washington Post.

Výzkumníci provedli experiment, při kterém měli roboti vybavení umělou inteligencí za úkol skenovat obličeje a rozdělovat je na zločince a nezločince. Ukázalo se, že si vybírali hlavně lidi tmavé pleti.

Implementovaný algoritmus umělé inteligence byl vycvičen pomocí strojového učení na obrovském souboru dat založeném na fotografiích s popisky. V pozdější fázi testování se ukázalo, že roboti vykazují nejen rasistické, ale i sexistické chování. Mezi ně patří i téměř neustálé přidělování žen na úklidové práce a práce v domácnosti.

Poslední příklady nejsou jediné, kdy roboti prokázali toto špatné chování. V minulosti umělá inteligence odpovědná za předpovídání pravděpodobnosti spáchání trestného činu spíše identifikovala černochy a Hispánce. Většinou v případě „podezřelých“ nebylo takové posouzení uvedeno.

Pro morálku neexistuje matematický vzorec

Výzkumníci z univerzity Johna Hopkinse prokázali neredukovatelné předsudky virtuálních strojů, které se často shodují s bolestnými postoji mnoha lidí s předsudky, kteří se na ostatní dívají stereotypně a zraňujícím způsobem. Úkolem vědců nyní bude eliminovat rasistické a sexistické jednání tím, že stroje odpovídajícím způsobem naprogramují.

Pokud mají roboti v budoucnu vykonávat lidskou práci, například doručovat různé zboží lidem, včetně pacientů v nemocnicích, nemohou se chovat jako nyní. Musí pochopit, že lidé jsou si rovni a s nikým z nich by se nemělo zacházet hůře kvůli barvě pleti nebo pohlaví.

Etický dohled nad robotikou je nezbytný – musí za něj odpovídat lidé, kteří v softwaru strojů vytvoří pokyny pro morální chování. Schémata jednání zohledňující svědomí je něco, co žádný stroj neopakuje. Morální paradigmata nejsou akce nula-jedna.

Etické stroje ještě dlouho nebudou vytvořeny

Zatím je těžké říci, kdy přesně se objeví roboti a algoritmy umělé inteligence, které budou rozumět otázce morálky a tomu, že nikdo nemůže být diskriminován na základě příslušnosti k určité etnické skupině nebo pohlaví, i když v databázi strojového učení je spousta příkladů jednání, které je třeba odhalit. Na druhou stranu, jednodušší způsob, jak se na to podívat, by bylo vyvážit soubor informací, které jsou implementovány pro trénování algoritmů.

V současné době roboti dobře vykonávají strojní práce, u nichž není důležité brát ohled na morální aspekty. Úkoly typu „přines, odnes, zamet‘ jsou mnohem jednodušší než posouzení situace z etického hlediska. Tento problém se již řešil při výcviku umělé inteligence v autonomních automobilech, kdy stroj musel vyhodnotit, zda je lepší srazit chodce, nebo riskovat zranění řidiče. V takových situacích je třeba, aby člověk robotovi vysvětlil, že je možné riskovat třetí možnost, která není z matematických výpočtů zřejmá.

Zdroj: washingtonpost.com