Zloději napodobí hlas člena rodiny a z jeho telefonního čísla žádají o peníze. Českem se šíří zákeřný podvod

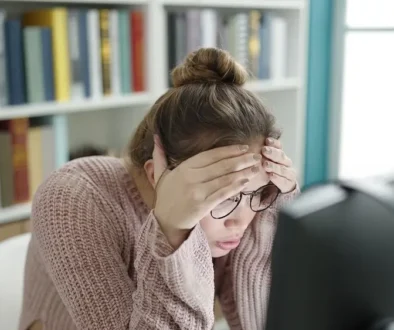

Česko zasáhla nová vlna promyšlených telefonních podvodů. Jsou natolik zákeřné, že na ně může skočit naprosto každý. Zloději totiž dokážou napodobit hlas vašeho příbuzného nebo přítele a z jeho telefonního čísla žádají o peníze. Nebezpečnost zvyšuje fakt, že moderní technologie jsou běžně dostupné a zdarma a realistickou imitaci s nimi zvládne vytvořit i naprostý laik. Dá se proti tomu bránit?

Na začátku stojí zdánlivě nevinný telefonát. Známý člověk vám sdělí, že je ve finanční nouzi a potřebuje vaši pomoc. Řekne vám částku, kterou mu máte poslat. Protože mluví hlasem člena vaší rodiny či kamaráda a navíc volá z jeho telefonního čísla, zřejmě vás nenapadne zpochybňovat jeho věrohodnost a požadované peníze mu opravdu pošlete. Snadno se tak stanete obětí zákeřného podvodníka, který pro své zločinné aktivity využívá nástroje umělé inteligence.

Podvod, kterému uvěříte

Praktiky podvodníků využívajících telefony a sociální sítě se dostaly na novou úroveň. Díky moderním technologickým postupům dokážou nyní nejenom napodobit hlas, ale také imitovat telefonní čísla. Dosahují toho pomocí takzvaného „spoofingu“. Na displeji oběti se zobrazí skutečné číslo příbuzného nebo státní instituce (Policie ČR, Finanční úřad, banka atd.), což výrazně zvyšuje důvěryhodnost podvodu.

Zlodějům stačí 15 vteřin, aby napodobili váš hlas

K vytvoření věrné kopie hlasu potřebují podvodníci pouhých 15 sekund zvukového záznamu, který snadno získají ze sociálních sítí nebo během krátkého telefonátu. Čím větším množství nahrávky disponují, tím je konečný výsledek propracovanější.

„Kdyby si někdo dal tu práci a podařilo se mu shromáždit 20 minut vaší řeči, AI model by se díky tomu dotrénoval a výsledek by byl mnohem lepší,“ prozradil v rozhovoru s Českým rozhlasem Anton Firc, doktorand na Ústavu inteligentních systémů na Vysokém učení technickém v Brně, který se problematikou zabýval ve svém výzkumu.

Imitaci hlasu vytvoří běžně dostupná aplikace či program

Mezi nejpopulárnější patří nástroje jako Speechify, ElevenLabs, Murf AI nebo Descript. Tyto platformy původně sloužily pro tvorbu podcastů, audioknih nebo profesionálních nahrávek. Jejich dostupnost a jednoduché použití z nich ale udělaly ideální pomůcku pro kyberzločince, burcují na poplach bezpečnostní experti z celého světa.

Počet deepfake útoků v poslední době prudce vzrostl. V roce 2023 to v Evropě bylo o 780 %.

Jak se bránit

Máme pro vás naštěstí dobrou zprávu. Pořád existují způsoby, jak se bránit i těmto pokročilým technologiím, minimálně prozatím. Pro případy, kdy po vás druhá strana bude vyžadovat peníze, můžete v rodině zavést kódová slova pro ověření identity. Pravost hovoru si můžete ověřit také tím, že dané osobě zavoláte zpět.

„Důležité je nevěřit slepě telefonátům. I při malém podezření hovor ukončete a dotyčnému zavolejte znovu. Ne přes historii volání, ale rovnou z telefonního seznamu nebo přes aplikaci typu WhatsApp nebo Signal,“ radí Jan Cibulka z podcastu Českého rozhlasu Antivirus.

Hrozba do budoucna

Vývoj umělé inteligence pokračuje exponenciálním tempem. S tím bohužel souvisejí i nepřeberné možnosti jejího zneužití. Účinná obrana dosud neexistuje, protože vývoj AI je tak rychlý, že se mu lidská společnost neumí včas přizpůsobovat. Experti předpokládají, že podvodníci brzy začnou kombinovat AI hlasové klonování s AI generovanými videi, například v podobě videohovoru, což vytvoří ještě věrohodnější podvody.